Қазіргі жаһандану дәуірінде ақпараттық технологиялардың дамуы барлық қоғамдық қатынастарды түбегейлі өзгертуде, деп жазады Ertenmedia.kz.

Бүгінде жасанды интеллект инновациялық құрал болумен қатар, киберқылмыскерлер үшін қуатты технологиялық қаруға айналды. Әсіресе, адамның биометриялық деректерін өзгерту арқылы жасалатын «Deepfake» технологиясы ұлттық қауіпсіздікке және жеке адамның құқықтық қорғалуына айтарлықтай қауіп төндіреді.

Дипфейк технологиясы адамның бет-әлпетін, дауысын және қимылдарын нейрондық желілер көмегімен дәл қайталауға мүмкіндік береді. Егер бұрын алаяқтар тек мәтіндік хабарламалар немесе фишингтік сілтемелер арқылы әрекет етеді.

Қазіргі таңда олар жасанды интеллект көмегімен мемлекеттік қызметкерлердің, ірі компания басшыларының жалған цифрлық бейнесін жасап, үлкен қаржылық шығындарға әкелуде. Бұл тек технологиялық қана емес, сонымен қатар құқықтық реттеуді қажет ететін күрделі мәселе.

Бұл мәселе Қазақстанда да өзекті. ҚР Ішкі істер министрлігінің мәліметінше, елімізде киберқылмыстың үлесі өсіп, жыл сайын мыңдаған интернет-алаяқтық фактісі тіркелуде. Соңғы жылдары ақпараттық жүйелер арқылы жасалатын алаяқтық көбейіп барады. Бұрын қылмыскерлер тек телефон арқылы алдаса, қазір жасанды интеллект арқылы жасалған жалған аудио және бейне материалдарды пайдалануда.

Дамыған елдерде бұл мәселе заңдық тұрғыда реттеліп келеді. Мысалы, Еуропалық Одақта қабылданған «Жасанды интеллект туралы акт» (EU AI Act) дипфейк мазмұндарды міндетті түрде арнайы белгімен (watermarking) таңбалауды талап етеді. АҚШ пен Оңтүстік Кореяда жасанды интеллект арқылы жалған ақпарат таратуға қатаң қылмыстық жауапкершілік қарастырылған.

Қазақстанда да құқықтық жүйені осы бағытта дамыту қажет. Қылмыстық кодексте киберқылмыс бойынша баптар бар, бірақ жасанды интеллектіні қолдануды «жазаны ауырлататын мән-жай» ретінде қарастыру қажет.

Сонымен қатар, цифрлық дәлелдемелерді жинау және олардың түпнұсқалығын анықтау бойынша процестерді жетілдіру маңызды. Жасанды интеллект арқылы жасалған аудио және бейне материалдарды сотта пайдалану үшін олардың түпнұсқалығын тексеретін арнайы техникалық сараптама институтын дамыту қажет.

Сонымен бірге, биометриялық деректердің қауіпсіздігі мәселесі де өзекті. Банк жүйелері мен мемлекеттік қызметтердегі FaceID немесе дауыстық сәйкестендіру жүйелері жасанды интеллект шабуылдарына төтеп бере алуы керек. Сондықтан құқық қорғау органдарын жасанды интеллект негізіндегі құралдармен жабдықтау маңызды. Ғылыми тұрғыдан, IT мамандары мен заңгерлер бірлесіп жұмыс істейтін кибер-криминалистика саласын дамыту керек.

Контекст

Мемлекеттік деңгейде халықтың цифрлық сауатын арттыру бағдарламалары қажет. Әрбір азамат өзінің биометриялық деректеріне сақ болуы керек. Көпсатылы тексеру және отбасы ішінде арнайы құпия кодтарды пайдалану жасанды интеллект арқылы жасалатын шабуылдардан қорғанудың тиімді жолы бола алады.

Қорыта айтқанда, жасанды интеллект дәуіріндегі қауіпсіздік тек техникалық мәселе емес. Бұл кешенді құқықтық, этикалық және әлеуметтік жауапкершілікті талап етеді. Біз технологиялық дамудан бас тарта алмаймыз, алайда технологияларды заңды түрде дұрыс қолдануды қамтамасыз ету – біздің басты міндетіміз. Тек халықаралық тәжірибені ескере отырып, заңнаманы жетілдіру арқылы ғана біз цифрлық кеңістіктегі қауіпсіздігімізді нығайта аламыз.

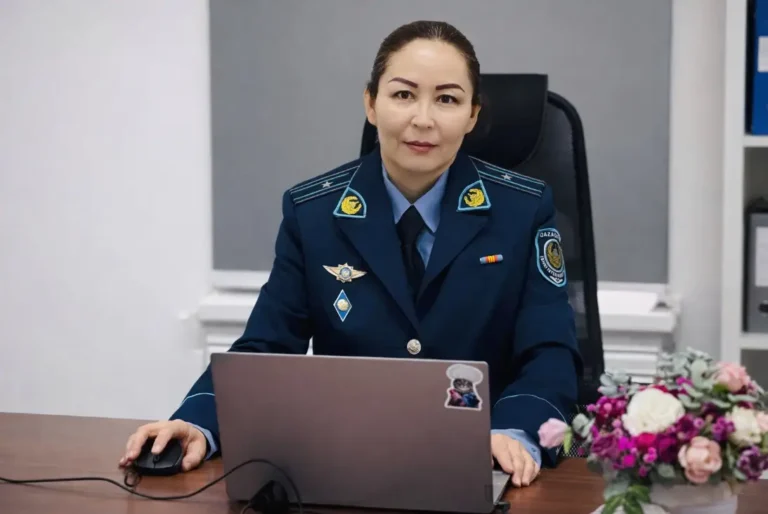

Нұргүл Құбанова, ҚР ІІМ М. Есболатов атындағы Алматы академиясы киберқауіпсіздік және ақпараттық технологиялар кафедрасының аға оқытушысы, полиция майоры, заң ғылымдарының магистрі.

Таяуда YouTube платформасы дипфейктерді анықтау мүмкіндігін саясаткерлер, мемлекеттік қызметкерлер, саяси кандидаттар және журналистер үшін кеңейтетінін хабарлады.

📌 Ertenmedia-ның Telegram арнасына жазылыңыз: қысқа әрі нұсқа, ең өзекті ақпарат осында!